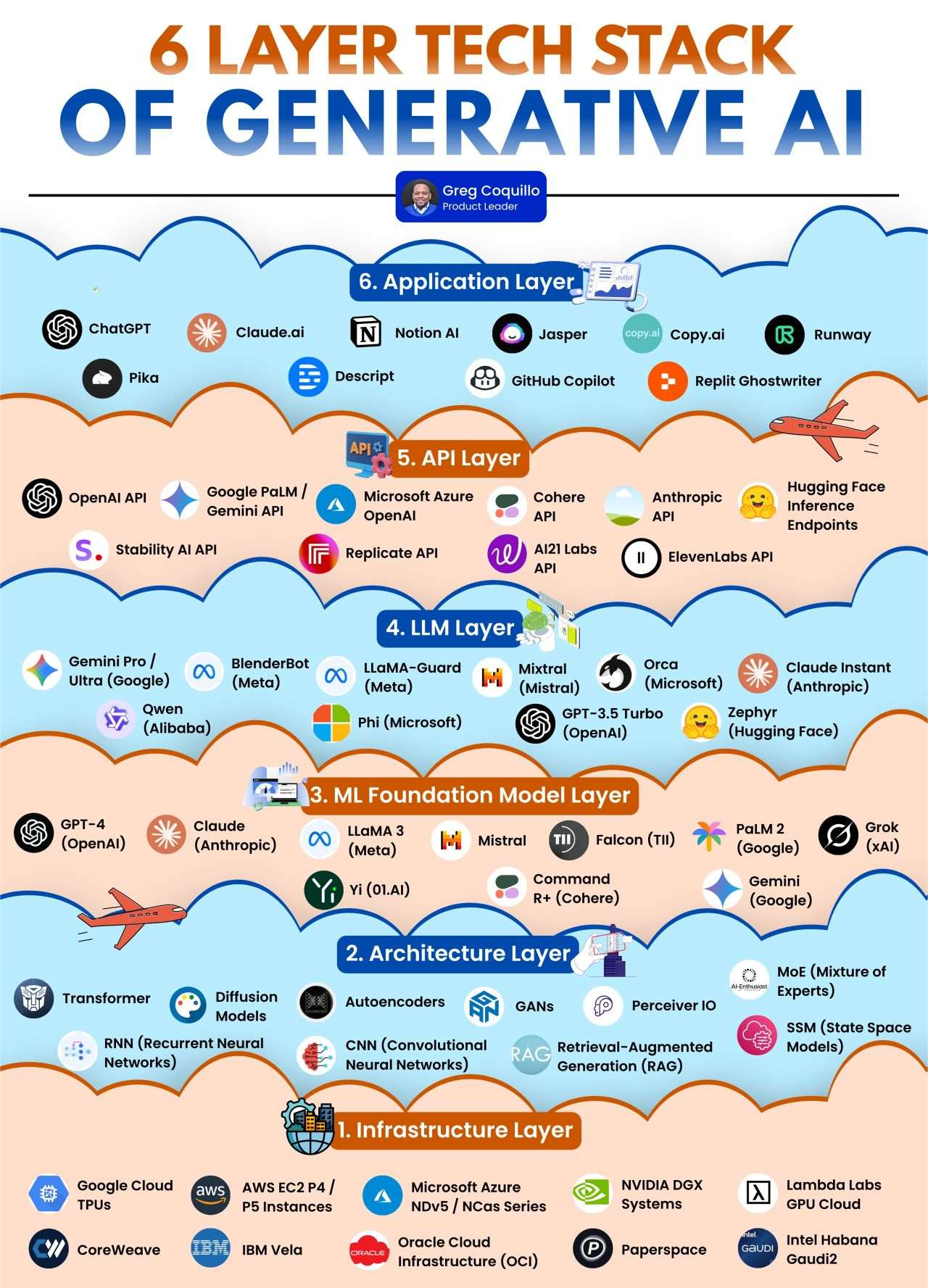

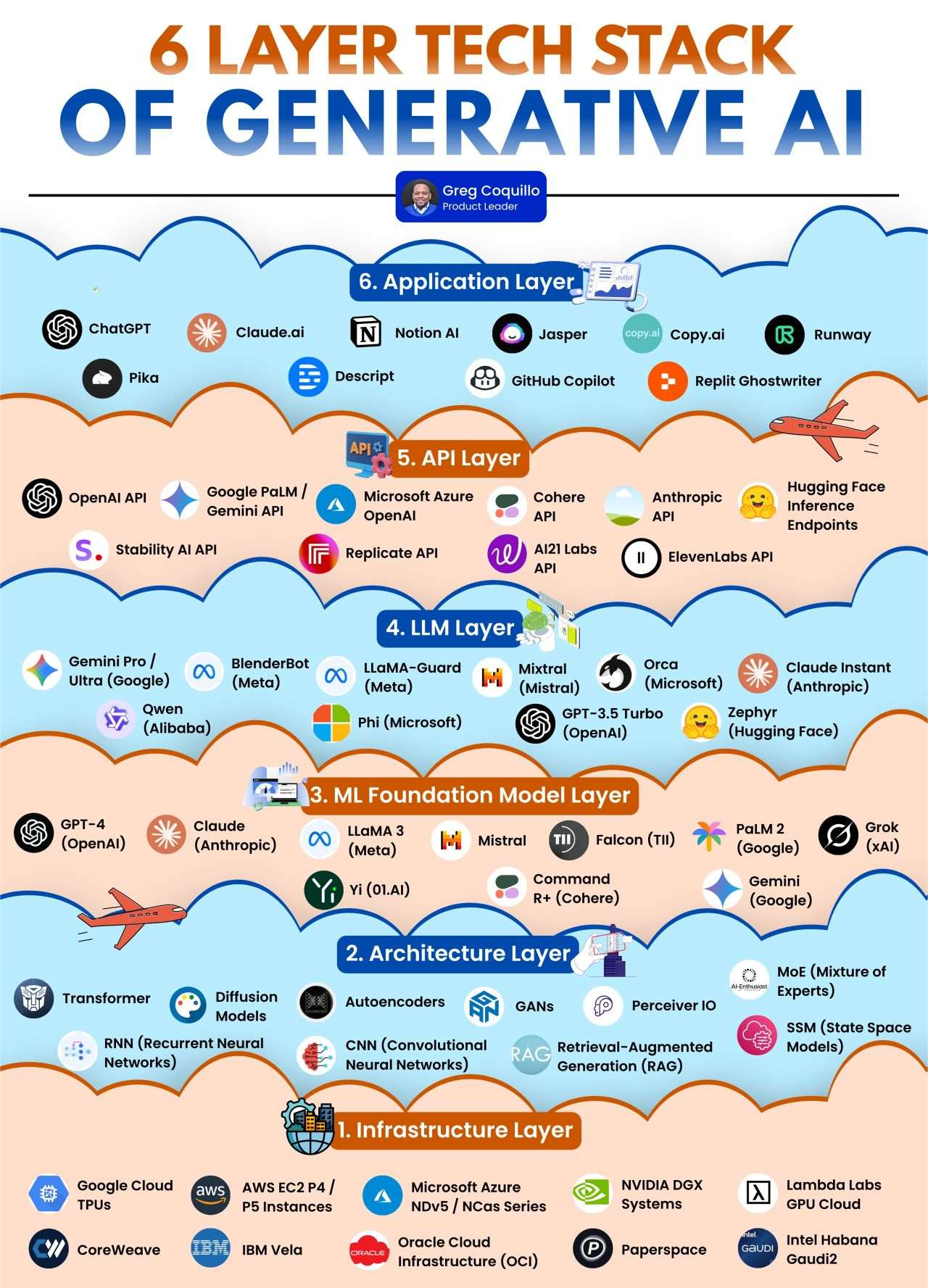

6 Layer Tech Stack of Generative AI

生成式AI六层技术栈解读

这幅图展示的是由产品经理 Greg Cuilioli 提出的「生成式AI六层技术栈」(6 Layer Tech Stack of Generative AI)。

1. 基础设施层 (Infrastructure Layer)

核心功能:为生成式AI提供底层计算和存储资源。

包含组件:Google Cloud TPUs、AWS EC2 P4/P5实例、Microsoft Azure NDv5/NCas系列、NVIDIA DGX系统、Lambda Labs GPU云、CoreWeave、IBM Vela、Oracle Cloud Infrastructure、Paperspace、Intel Habana Gaudi2等。

可挖掘的点:

计算资源的成本与性能平衡是生成式AI发展的关键瓶颈

专用芯片(如TPU、GPU、Gaudi2)的竞争加速了AI基础设施的创新

云服务提供商在AI基础设施领域的激烈竞争推动了价格下降

边缘计算在生成式AI部署中的潜力和挑战

绿色计算技术在AI基础设施中的应用(降低能耗)

适合公司:云服务提供商(AWS、Google Cloud、Azure)、芯片制造商(NVIDIA、Intel)、以及需要大规模AI计算资源的科技公司。

2. 架构层 (Architecture Layer)

核心功能:定义生成式AI的基本模型架构和技术路线。

包含组件:Transformer、扩散模型(Diffusion)、自编码器(Autoencoders)、生成对抗网络(GANs)、Perceiver IO、混合专家模型(MoE)、循环神经网络(RNNs)、卷积神经网络(CNNs)、检索增强生成(RAG)、状态空间模型(SSM)等。

可挖掘的点:

Transformer架构的持续演进(如GPT系列、LLaMA系列)

扩散模型在图像生成领域的主导地位及未来发展

RAG技术如何解决大语言模型的知识时效性和准确性问题

混合专家模型(MoE)在模型规模和效率之间的平衡

新型架构(如SSM)对传统Transformer的挑战

适合公司:AI研究实验室(OpenAI、DeepMind、Meta AI)、学术机构、以及专注于AI模型架构创新的科技公司。

3. 机器学习基础模型层 (ML Foundation Model Layer)

核心功能:构建强大的通用AI基础模型。

包含组件:GPT-4(OpenAI)、Claude(Anthropic)、LLaMA 3(Meta)、Mistral(Mistral AI)、Falcon(TII)、PaLM 2(Google)、Grok(xAI)、Yi(01.AI)、Command R+(Cohere)、Gemini(Google)等。

可挖掘的点:

基础模型的规模竞赛(参数数量、训练数据量)

开源模型(如LLaMA、Mistral)与闭源模型(如GPT-4、Claude)的竞争格局

多模态基础模型(文本、图像、音频、视频)的融合趋势

基础模型的对齐(Alignment)问题与安全挑战

小型化基础模型(如Gemini Nano、Phi)的发展潜力

适合公司:大型科技公司(OpenAI、Meta、Google)、专注于基础模型研发的AI startups(Mistral AI、Anthropic)、以及有能力进行大规模模型训练的企业。

4. 大语言模型层 (LLM Layer)

核心功能:基于基础模型构建专门用于处理语言任务的模型。

包含组件:SemiMini/Ultra(Google)、BlenderBot(Meta)、LLaMA-Guard(Meta)、Mixtral(Mistral)、Orca(Microsoft)、Claude Instant(Anthropic)、Qwen(Alibaba)、Phi(Microsoft)、GPT-3.5 Turbo(OpenAI)、Zephyr(Hugging Face)等。

可挖掘的点:

轻量级LLM在边缘设备和移动应用中的部署优势

专门化LLM(如代码生成、医疗、法律)的发展趋势

LLM的上下文窗口扩展(从几千到百万级tokens)

LLM的推理效率优化(量化、蒸馏、剪枝技术)

开源社区在LLM生态中的重要作用

适合公司:基础模型提供商、专注于特定领域LLM开发的公司、以及需要定制化语言模型的企业。

5. API层 (API Layer)

核心功能:提供标准化的接口,使开发者能够轻松访问生成式AI模型的能力。

包含组件:OpenAI API、Google PaLM/Gemini API、Microsoft Azure OpenAI API、Cohere API、Anthropic API、Hugging Face Inference Endpoints、Stability AI API、Replicate API、AI21 Labs API、ElevenLabs API等。

可挖掘的点:

API定价策略对生成式AI应用成本的影响

API的速率限制和扩展性挑战

API提供商的服务质量和可靠性保障

定制化API与通用API的权衡

API生态系统的竞争与合作(如Hugging Face的开放生态)

适合公司:基础模型提供商、API服务聚合商、以及需要将AI能力快速集成到现有产品中的企业。

6. 应用层 (Application Layer)

核心功能:直接面向终端用户提供生成式AI应用服务。

包含组件:ChatGPT、Claude.ai、Notion AI、Jasper、Copy.ai、Runway、Pika、Descript、GitHub Copilot、Replit Ghostwriter等。

可挖掘的点:

垂直领域应用(如法律、医疗、教育)的增长潜力

用户体验设计在生成式AI应用中的重要性

生成式AI与传统软件的融合模式

应用的商业化路径和盈利模式

用户数据隐私和内容安全问题

适合公司:各种类型的公司,从初创公司到大型企业,如OpenAI(ChatGPT)、Adobe(创意工具)、微软(GitHub Copilot)等。

总结:六层技术栈在AI工程化中的意义

生成式AI六层技术栈为AI工程化提供了清晰的技术分层和生态系统视图,其核心意义在于:

系统化认知:帮助开发者和企业全面理解生成式AI的技术构成和生态系统

分工协作:各层有明确的职责边界,便于不同类型的公司在各自擅长的领域进行创新

技术选型:为企业在构建或采用生成式AI解决方案时提供决策框架

风险评估:帮助识别技术栈中的关键依赖和潜在风险

创新方向:指导企业在技术栈的不同层级寻找创新机会

与八层智能代理架构的区别

核心焦点不同:

六层技术栈专注于生成式AI的技术实现和应用,从基础设施到终端应用

八层智能代理架构专注于智能代理(Agentic AI)的能力构建,强调代理的认知、记忆、协作和治理

层级划分不同:

六层技术栈更侧重于技术实现的垂直分层,从底层计算到上层应用

八层智能代理架构包含更多关于代理智能能力的层次(如认知与推理层、记忆与个性化层)和治理层

应用范围不同:

六层技术栈适用于所有类型的生成式AI应用

八层智能代理架构更专门针对具有自主决策和协作能力的智能代理系统

工程化重点不同:

六层技术栈强调技术实现和生态系统建设

八层智能代理架构更强调智能代理的工程化治理、协作机制和个性化能力

总体而言,六层技术栈提供了生成式AI的通用技术框架,而八层智能代理架构则是在其基础上,针对智能代理这一特定类型的生成式AI应用提供的更细化、更专注的架构设计。